Estupro coletivo de crianças em SP: 'Esses conteúdos são vendidos em grupos sem intervenção das plataformas'

Crédito, Getty Images

Um estupro coletivo de duas crianças, de 7 e 10 anos, em São Paulo só chegou ao conhecimento das autoridades após as imagens do crime circularem nas redes sociais e a irmã de uma das vítimas reconhecê-la nas imagens.

Para especialistas ouvidos pela BBC News Brasil, o caso evidencia o papel ambivalente das empresas de tecnologia que administram essas plataformas.

Ao mesmo tempo em que permitem a circulação de conteúdo ilegal, também podem contribuir para denúncia e mobilização, ajudando a expor crimes e a pressionar por investigação.

No caso do estupro coletivo em São Paulo, segundo a Polícia Civil, a irmã de uma vítima a identificou em um vídeo compartilhado na internet e procurou uma delegacia para registrar a ocorrência. O crime havia ocorrido três dias antes, em 21 de abril.

A polícia diz ter identificado então os suspeitos e feito as primeiras apreensões e prisões. Ao todo, sete pessoas são investigadas — quatro adolescentes já foram apreendidos, um quinto está foragido e um homem adulto foi preso na Bahia, de onde deve ser transferido para São Paulo.

Segundo a delegada Janaína da Silva Dziadowczyk, responsável pelo caso, os suspeitos eram vizinhos das vítimas e eram pessoas de sua confiança.

"Chamaram para soltar pipa, eles foram atraídos para esse imóvel. Falaram 'vamos soltar pipa, entra aqui que tem uma linha'", disse a delegada em entrevista coletiva.

A delegada afirmou ainda que as vítimas e seus familiares estavam sendo pressionados na comunidade em que viviam para não registrarem boletim de ocorrência na delegacia.

Agora você pode receber as notícias da BBC News Brasil no seu celular.

Clique para se inscrever

Fim do Whatsapp!

"Embora as imagens estivessem circulando na internet, a família não havia registrado queixa. O que me foi passado é que eles queriam resolver lá entre eles e não queriam que a polícia tomasse conhecimento", disse Dziadowczyk.

Ela ressaltou que, por conta desta pressão, as famílias das vítimas decidiram deixar a comunidade em que viviam por medo de represálias.

"Teve gente que saiu com a roupa do corpo. Então, foi uma dificuldade encontrar essas vítimas", completou.

De acordo com a investigação, o homem adulto teria iniciado as agressões e feito as gravações, que depois foram compartilhadas por meio do WhatsApp e passaram a circular nas redes sociais.

Segundo a delegada Janaína Dziadowczyk, um dos adolescentes suspeitos de envolvimento no crime disse que "foi uma brincadeira que acabou escalando".

"A iniciativa de gravar foi do maior [de idade], foi ele quem começou, segundo eles, as brincadeiras, e ele começou a gravar no próprio celular e depois pediu que o outro menor gravasse."

Após a identificação dos envolvidos, a polícia agora tenta rastrear a origem e a disseminação das imagens.

"No primeiro momento a gente tinha a prioridade de identificar os agressores. No segundo momento, vamos atrás para saber quem divulgou essas imagens", afirmou o delegado Júlio Geraldo, que também está à frente do caso.

As especialistas ouvidas pela reportagem pontuam que as plataformas de redes sociais e mensagens devem ser cobradas por como reagem para coibir o compartilhamento desse tipo de conteúdo, embora pontuem ser difícil interromper por completo sua circulação, especialmente em aplicativos como o WhastApp, por conta da tecnologia que protege o acesso de terceiros às mensagens privadas.

Mas as especialistas ressaltam que já existem tecnologias avançadas para fazer isso e que a propagação de conteúdos de abuso infantil indicam que os controles existentes não funcionaram.

Acrescentam ainda que as empresas que administram essas redes e aplicativos têm reiteradamente falhado no monitoramento e controle da divulgação e comercialização destes, o que tem levado a uma "explosão" de casos como este.

A BBC News Brasil questionou a Meta, dona do WhatsApp, sobre quando tomou conhecimento do caso, se identificou e removeu contas envolvidas na circulação das imagens e quais medidas foram adotadas para impedir a redistribuição das imagens.

A reportagem questionou ainda a Meta se esse conteúdo foi detectado por sistemas próprios da companhia ou se isso ocorreu apenas após denúncia.

A Meta não respondeu diretamente a essas perguntas sobre o caso de estupro coletivo em São Paulo. Em nota, afirmou que usa tecnologias para detectar casos de abuso infantil e que remove conteúdos e contas associados a isso assim que identificados.

"De outubro a dezembro de 2025, dentre os conteúdos removidos globalmente do Facebook e do Instagram por violações às regras contra exploração sexual infantil, cerca de 97% foram identificados e removidos proativamente, antes de qualquer denúncia", disse a empresa, acrescentando que envia as denúncias que recebe à Policia Federal e compartilha informações com outras empresas de tecnologia.

Sobre o WhatsApp, a Meta ressaltou que tem "equipes especializadas em eliminar interações abusivas", que encoraja os usuários a denunciarem casos de abusos às autoridades e que tem constantemente aprimorado suas tecnologias para detectar abusos.

"Usando essas técnicas, o WhatsApp faz mais do que qualquer outro serviço de mensagens com criptografia de ponta a ponta para prevenir e combater esse tipo de abuso hediondo, e bane mais de 300 mil contas por mês, globalmente, por suspeitas de compartilhamento de imagens contendo exploração infantil."

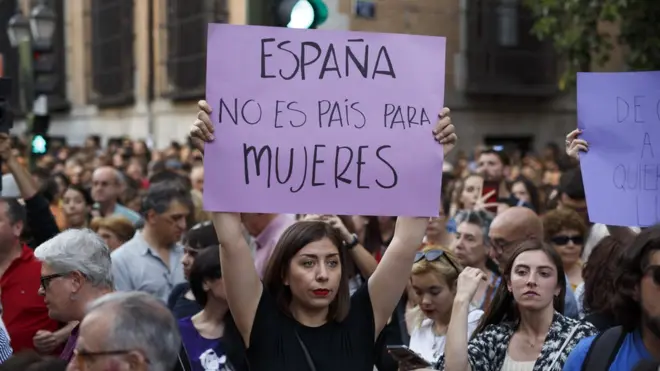

Crédito, Getty Images

O duplo papel das redes sociais em casos de abuso

A forma como se desenrolou o caso do estupro coletivo ilustra como as plataformas digitais podem ter um papel duplo em crimes deste tipo, dizem especialistas.

"Os mesmos espaços que geram exposição e permitem que conteúdos circulem também fazem parte da cadeia de atores necessários para que a gente encontre uma solução", diz Bruna Santos, gerente de políticas públicas e incidência da Witness, organização global que atua no uso de vídeo e tecnologia audiovisual para documentar violações de direitos humanos.

As novas tecnologias têm levado a uma "explosão de casos" e também a novas formas de violência contra crianças e adolescentes, diz Yasmin Curzi, professora de Direito da Fundação Getúlio Vargas Direito do Rio de Janeiro e pesquisadora do Centro de Tecnologia e Sociedade (CTS-FGV).

"Existe um aumento de escala — qualquer pessoa pode acessar esse tipo de conteúdo — e também a possibilidade de que essas violências sejam filmadas. Isso gera uma revitimização permanente, porque essas imagens dificilmente desaparecem", afirma a pesquisadora.

Para ela, o problema vai além das redes sociais abertas. "Estamos falando também de aplicativos de mensagens, onde muitas vezes esses conteúdos circulam e até são comercializados em grupos dedicados, sem intervenção das plataformas", diz Curzi.

"Investigações conseguem mapear a existência desses grupos, mas a circulação tende a migrar entre plataformas."

Santos argumenta que as empresas de tecnologia não devem ser cobradas necessariamente por haver conteúdos deste tipo circulando em suas plataformas — especialmente em serviços criptografados.

"A responsabilização passa pelo momento em que essas empresas deixam de implementar salvaguardas proporcionais para reduzir a circulação desse tipo de material ou não agem com rapidez diante de denúncias", diz Santos.

"Esses conteúdos podem se espalhar muito rapidamente antes de qualquer denúncia, e é muito difícil interromper a circulação depois que começam a ser enviados."

Santos aponta, no entanto, que as empresas de tecnologia têm falhado reiteradamente em criar e aplicar mecanismos eficazes de denúncia e resposta em casos como esse.

"Isso tem impacto direto na reprodução da violência, na exposição das vítimas e na possibilidade de revitimização", afirma.

Curzi ressalta que, no caso específico de imagens de abuso sexual infantil, as tecnologias de detecção já são relativamente avançadas.

"Ferramentas como o hash matching — que identificam imagens já conhecidas de abuso — são bastante efetivas e amplamente utilizadas pelas grandes plataformas. Quando esse tipo de conteúdo circula, isso pode indicar uma falha significativa na aplicação da moderação", diz.

"Qualquer pessoa hoje se torna produtora e amplificadora em potencial. Sem cuidados básicos e sem moderação adequada, conteúdos ilegais ganham escala de forma sem precedentes."

Curzi acrescenta que, no Brasil, já há instrumentos legais que exigem uma atuação mais ativa das empresas.

"As plataformas precisam se adequar ao Estatuto da Criança e do Adolescente [ECA] e também a decisões recentes do Supremo Tribunal Federal. Em casos de violência contra crianças e adolescentes, não é necessária ordem judicial para retirada de conteúdo — trata-se de um dever proativo", afirma a pesquisadora.

Além disso, em março, entrou em vigor o Estatuto Digital da Criança e do Adolescente, o ECA Digital, que estabelece diretrizes para proteger o público infanto-juvenil nos meios digitais, e é considerado por especialistas como um marco na proteção das crianças e adolescentes no mundo virtual.

O ECA Digital foi aprovado depois que o influenciador Felipe Bressanim Pereira, o Felca, publicou um vídeo, em agosto do ano passado, denunciando perfis em redes sociais que usavam crianças e adolescentes para promover a sexualização desse público.

Isso acelerou o andamento de um projeto de lei de 2022 que estava parado na Câmara dos Deputados desde 2024.

A nova lei impõe, dentre as exigências para que plataformas, jogos e aplicativos possam operar, a obrigatoriedade de as empresas removerem conteúdos de aparente abuso ou exploração sexual, detectados em seus produtos ou serviços, com comunicação às autoridades nacionais e internacionais.

Para isso, não é necessário que haja uma denúncia, como a de Felca, para que a empresa remova o conteúdo.

Até então, as plataformas digitais não tinham obrigação legal de reportar diretamente às autoridades policiais brasileiras crimes cometidos em seus serviços.

Em muitos casos, as investigações têm início a partir de cooperação internacional entre forças policiais.

A Polícia Federal fica responsável por sistematizar as denúncias recebidas e encaminhá-las às autoridades policiais competentes para a investigação.

Curzi ressalta ainda que o debate sobre como combater a divulgação e compartilhamento desse tipo de conteúdo não deve girar em torno da criptografia.

"É um mecanismo fundamental para proteger a privacidade, que é um direito humano. Tratá-la como vilã pode abrir espaço para mais vigilância e violação de liberdades fundamentais. A resposta não pode ser simplesmente eliminar a criptografia", afirma.

Entre as medidas possíveis, Santos cita o fortalecimento de ferramentas nas plataformas — como alertas de conteúdo sensível, restrições ao compartilhamento em massa e mecanismos de preservação segura de evidências — além de iniciativas de educação digital para desencorajar o compartilhamento desse tipo de material.

"O problema é que o sistema hoje ainda é mais eficaz para punir depois do que para prevenir ou conter esse tipo de violência em tempo real", afirma Santos.